Microsoft, te estas pasando...

GitHub Copilot va a utilizar tu código privado el 24 de abril (y cómo evitarlo)

Ya lo vimos con Adobe. Ahora le toca a GitHub.

En junio de 2024, Adobe actualizó sus términos de uso y básicamente comunicó que sus sistemas automatizados podían analizar el contenido de los usuarios usando técnicas como el aprendizaje automático para mejorar sus servicios.

Eso incluía contenido bajo NDA, trabajo de clientes, diseños confidenciales…

Un artista conceptual lo resumió perfectamente en X: “¿No puedo usar Photoshop a menos que esté de acuerdo con que tengáis acceso completo a cualquier cosa que cree con él, incluyendo trabajo bajo NDA?”

El post tuvo 9,5 millones de visualizaciones.

Adobe se echó atrás. Comunicado aclaratorio. Promesas. La presión funcionó.

Pero aquí estamos, menos de un año después, y Microsoft hace exactamente lo mismo con GitHub Copilot.

A partir del 24 de abril, tus interacciones con Copilot, prompts, respuestas, fragmentos de código y contexto del repositorio, pueden usarse para entrenar sus modelos de IA. Si no haces nada, estás dentro. Si ya habías desactivado esto antes, dicen que tu preferencia se mantiene (lo he comprobado y confirmado). Pero si no lo recuerdas o nunca tocaste esa configuración, bienvenido al dataset.

El comunicado suena razonable. Hablan de “prácticas estándar de la industria”. De mejoras en la calidad del modelo, de que han probado con datos de Microsoft y han visto mejoras en múltiples lenguajes… Todo muy profesional.

Y tienen razón en una cosa: es una práctica estándar de la industria. Eso es exactamente el problema.

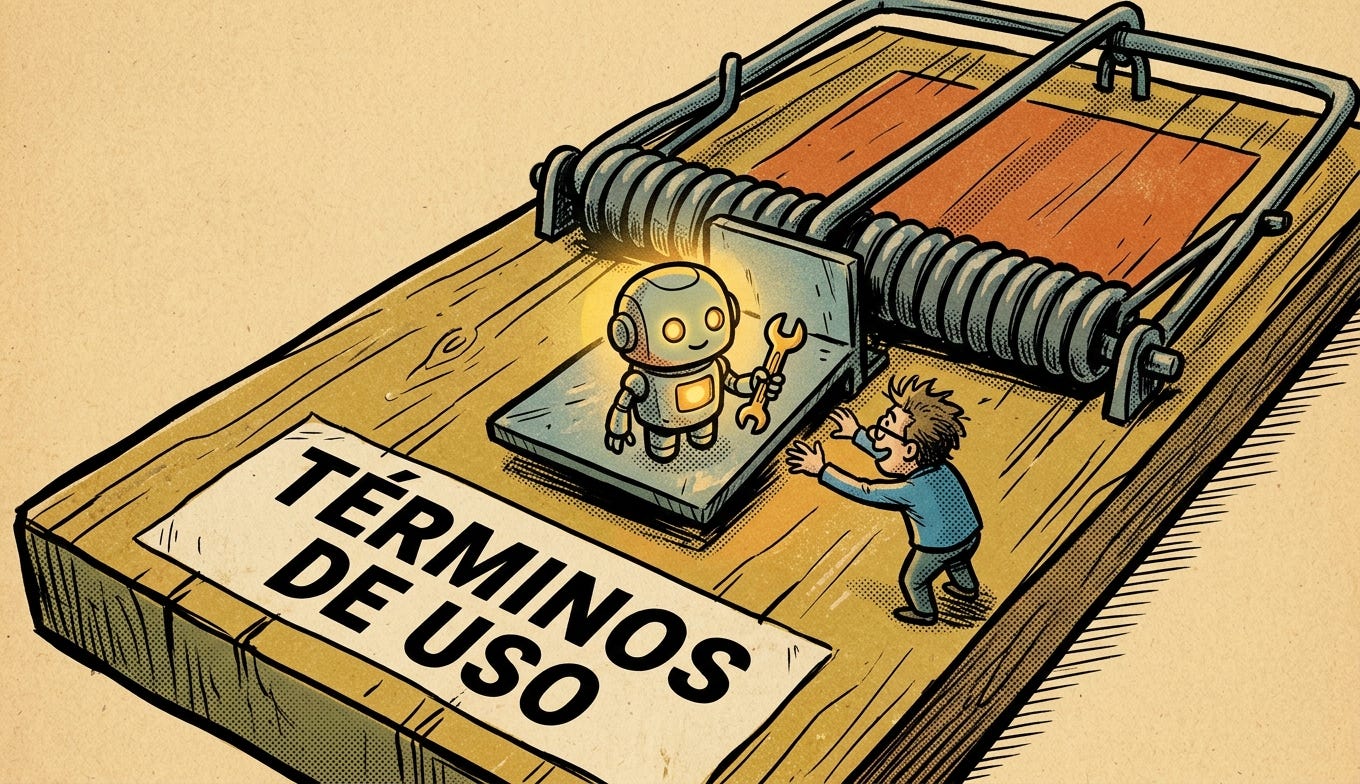

El modelo es siempre el mismo. Primero construyes dependencia. Cuando tienes suficientes usuarios que no pueden vivir sin tu herramienta, renegocías las condiciones. No con un contrato explícito, sino con una actualización de términos que la mayoría no lee, enterrada entre párrafos de jerga legal, con un botón de “Aceptar y continuar” que es obligatorio para seguir trabajando.

Con Adobe era tu trabajo creativo. Con Copilot es tu código. El código de tus clientes. La lógica de negocio de los proyectos en los que estás trabajando ahora mismo. Todo eso puede convertirse en datos de entrenamiento para los modelos de una empresa que no es la tuya y con la que no tienes ningún acuerdo de confidencialidad explícito para esto.

No digo que Microsoft sea el villano de la historia. Digo que este patrón está normalizado y que merece más atención de la que recibe.

Qué hacer si usas Copilot:

Ve a GitHub Settings, entra en la sección Copilot, y desactiva la opción de uso de datos para entrenamiento. Dos minutos. Hazlo hoy, no el 23 de abril.

Si usas Copilot en proyectos de clientes con código propietario, revisa también si tu empresa tiene políticas sobre esto. Puede ser relevante para tu contrato.

No es el fin del mundo. Pero sí es un recordatorio de que cuando el servicio es gratuito o casi gratuito, tú no eres el cliente. Eres la materia prima.